美团LongCat团队正式推出LongCat-Flash-Thinking-2601 —— 一款总参数量达5600亿、激活参数仅270亿的高效混合专家(MoE)大模型。该模型专为现实世界智能体任务设计,在工具调用、搜索推理、编程等场景中全面领先,并首次引入“深度思考模式”,显著提升复杂问题的解决能力。

三大核心技术亮点:

1、多环境强化学习 + 高质量任务合成:

团队构建了多个高复杂度训练环境,每个包含60+工具,并通过依赖图组织成密集交互网络。在此基础上:

– 任务自动生成:从环境子图中采样连通组件,确保任务可执行且具备多工具协同特性。

– 多样性控制:动态降低已用工具的采样概率,避免重复。

– 多环境联合训练:不同环境的任务按复杂度均衡混合,推演预算动态分配。

结果表明,随着训练环境数量增加,模型在域外评估中的表现持续提升,验证了其泛化能力的可扩展性。

2、抗噪鲁棒训练:直面现实世界的不确定性:

真实智能体环境充满缺陷:API延迟、返回错误、工具缺失等。为此,团队:

– 系统分析现实噪音类型(如响应失败、字段缺失、状态不一致)。

– 设计自动化流程将噪音注入训练环境。

– 采用课程学习策略:随训练推进逐步增加噪音强度与种类。

在专门构建的 τ²-Noise 和 VitaBench-Noise 基准上,LongCat-Flash-Thinking表现最优,证明其对环境扰动具备强适应能力。

3、深度思考模式:并行探索 + 迭代总结:

为应对极端复杂任务(如数学竞赛、多跳推理),模型支持 深度思考模式:

– 推理广度扩展:并行生成多条高温度思考轨迹,覆盖不同解题路径。

– 推理深度扩展:通过专用总结模型提炼关键信息,并递归反馈形成迭代优化循环。

– 专项强化训练:额外 RL 阶段专门优化总结能力。

进入LongCat-Flash-Thinking-2601测试模型官网入口

LongCat-Next多模态模型 - 美团龙猫团队推出支持100万Token超长文本处理

LFM2-24B-A2B模型使用入口,LiquidAI正式发布的LFM2家族模型

JoyAI-LLM-Flash模型官网入口,京东开源的中型指令大模型

LongCat-Flash-Lite官网:美团新一代高效大语言模型

UNO-Bench:美团LongCat团队研发全模态大模型的标准化评测基准

上面是“LongCat-Flash-Thinking-2601:美团LongCat团队推出高效混合专家大模型”的全面内容,想了解更多关于 AI项目和框架 内容,请继续关注web建站教程。

当前网址:https://m.ipkd.cn/webs_29790.html

声明:本站提供的所有资源部分来自互联网,如果有侵犯您的版权或其他权益,请发送到邮箱:admin@ipkd.cn,我们会在看到邮件的第一时间内为您处理!

pixiv网页版登录教程,pixiv网页版官网怎么进

pixiv网页版登录教程,pixiv网页版官网怎么进 Go语言多重循环如何运用break语句

Go语言多重循环如何运用break语句 Presti AI:专注于以生成式AI技术为家具行业提供定制化产品图像解决方案

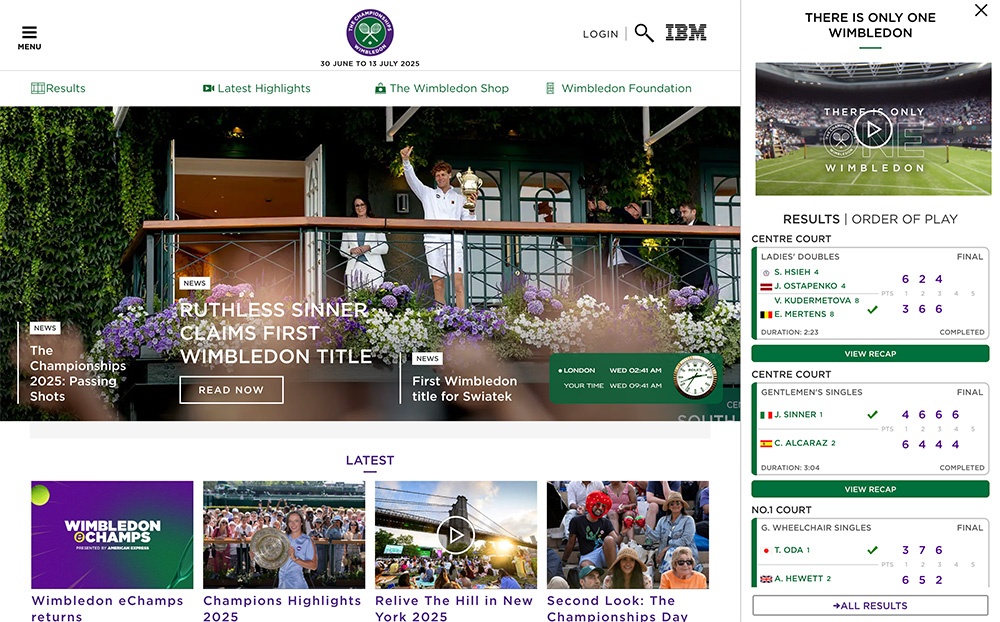

Presti AI:专注于以生成式AI技术为家具行业提供定制化产品图像解决方案 温网官网:起源于1877年,全球网球四大满贯赛事之一

温网官网:起源于1877年,全球网球四大满贯赛事之一 css3文字快闪切换动画效果代码

css3文字快闪切换动画效果代码 Seedance 2:字节跳动多模态AI视频生成模型,电影级创意落地工具

Seedance 2:字节跳动多模态AI视频生成模型,电影级创意落地工具