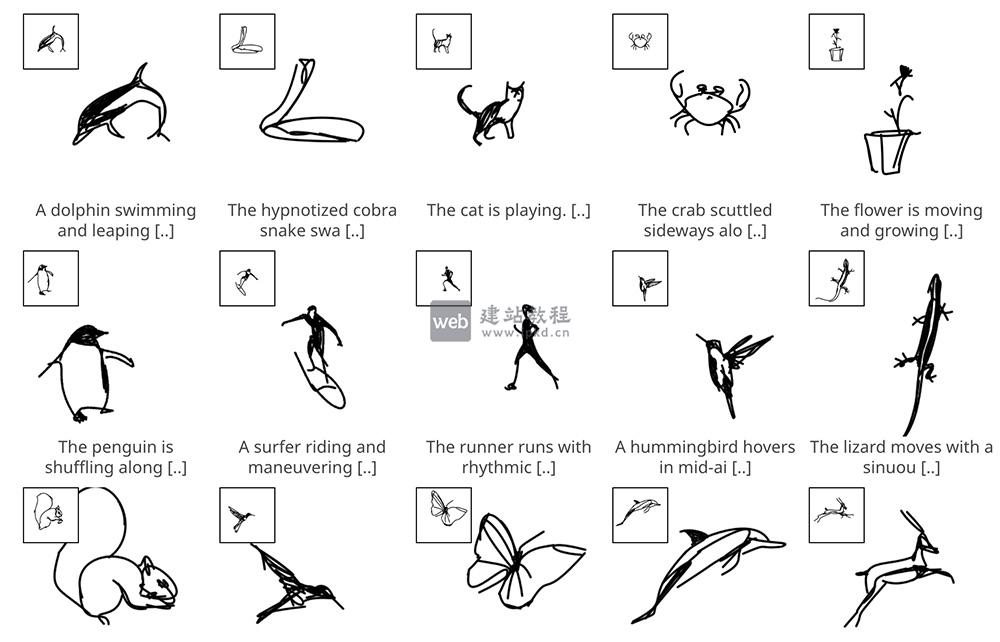

LiveSketch是一款聚焦“素描动效化”的AI生成视频工具,核心能力是通过简短文本提示,将静态素描自动转化为生动SVG动画片段。它为用户提供了直观、低门槛的创作方式,无需专业动画技能,就能让寥寥几笔的涂鸦或素描赋予生命,广泛适配讲故事、插画展示、网站设计、演示文稿等多元场景,让静态视觉内容更丰富有趣。

草图是人类直观传达想法的通用工具,而动画草图则为创意表达增添了动态维度,被设计师广泛应用于各类创作场景。但传统草图动画制作过程耗时费力,不仅需要丰富的设计经验,还依赖专业的动画技能,门槛极高。LiveSketch正是为解决这一痛点而生:用户只需输入描述所需运动的文本提示,就能自动为单主题草图添加运动效果;输出的矢量格式动画可轻松编辑调整,还能通过文本精准控制动画的动作形态与幅度。

LiveSketch核心技术原理:

LiveSketch无需大规模专项训练,核心是借力大型预训练文本到视频扩散模型的运动先验,通过分数蒸馏损失指导素描笔画的位置变化,实现动效生成。为了兼顾运动的自然流畅性与草图原始外观的完整性,技术方案中设计了两大核心组件:一是控制局部小范围变形的模块,保障细节动作自然;二是负责全局仿射变换的模块,确保整体运动协调。

值得注意的是,即便对于本身难以直接生成草图视频的模型,LiveSketch仍可作为动画抽象表示的有效骨干,展现出较强的技术适配性。

LiveSketch当前局限性:

1.控制范围有限:目前仅能通过修改运动描述类文本提示,对生成结果进行小幅调整,且可控动作局限于模型支持的小动作范畴;

2.文本语义约束:输入的文本提示需与初始草图的语义严格一致,否则无法精准驱动动效;

3.多对象适配不足:当草图主体包含多个对象时,无法区分不同对象并针对性添加动效,仅支持单主题素描的动效生成。

LiveSketch未来应用前景:

未来,LiveSketch这类技术有望在艺术创作、儿童教育等领域释放更大价值:既能大幅降低动画创作与艺术表达的门槛,让普通用户、儿童也能轻松实现创意动效创作;也能提升教育内容的趣味性与互动性,通过动态草图让知识讲解更直观易懂。

Ultralytics官网:一个轻量化开源计算机视觉与AI深度学习框架

FastBuildAI:一款面向AI开发者、创业者开源零代码AI应用开发框架

UniVG:百度团队研发的AI视频生成系统,支持文本、图像组合输入

EchoMimic:蚂蚁集团支付宝研发的高精度肖像动画生成工具

LivePortrait:快手科技与复旦大学联合开发的开源AI肖像动画技术框架

上面是“LiveSketch:文本驱动静态素描动画生成工具,让涂鸦轻松 “活” 起来”的全面内容,想了解更多关于 AI项目和框架 内容,请继续关注web建站教程。

当前网址:https://m.ipkd.cn/webs_27458.html

声明:本站提供的所有资源部分来自互联网,如果有侵犯您的版权或其他权益,请发送到邮箱:admin@ipkd.cn,我们会在看到邮件的第一时间内为您处理!

女生说731、95油分别代表什么意思?

女生说731、95油分别代表什么意思? 利用svg如何实现背景动画效果

利用svg如何实现背景动画效果 推荐一款由阿里达摩院开发的AI开源模型平台——ModelScope魔塔社区

推荐一款由阿里达摩院开发的AI开源模型平台——ModelScope魔塔社区 OpenStock:开源免费的股票市场分析工具

OpenStock:开源免费的股票市场分析工具 华律网是一个全面的法律服务、丰富的律师资源平台

华律网是一个全面的法律服务、丰富的律师资源平台