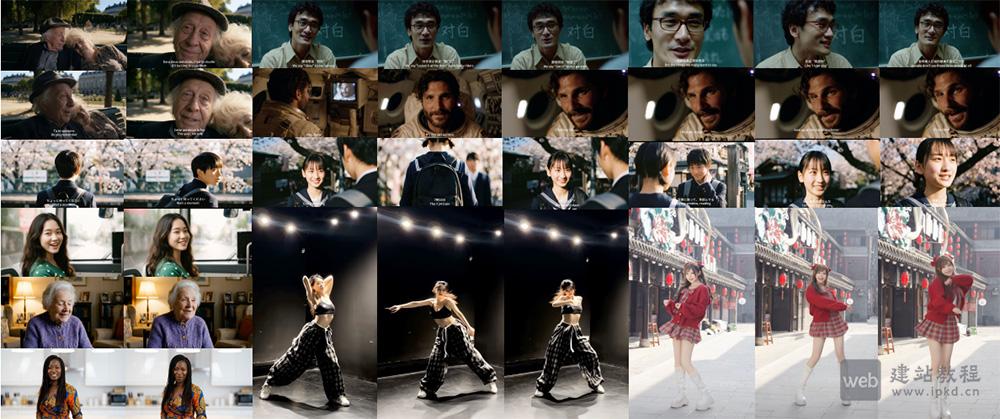

daVinci-MagiHuman是由上海创智学院GAIR实验室与Sand.ai联合开源的多模态统一生成模型。模型采用15B参数单流Transformer架构,统一建模文本、视频、音频三大模态,无需跨注意力机制;主打以人为中心的音视频同步生成,支持中英日韩德法等多语言,在单张H100上2秒即可生成5秒256p视频。在对比评测中,相比Ovi 1.1胜率达80%,相比LTX 2.3胜率达60.9%,目前代码、模型权重与在线Demo已全面开源。

daVinci-MagiHuman核心功能:

1、音视频联合生成:同步生成带自然语音、精准口型对齐的人物视频,实现音画一体输出。

2、多语言语音生成:支持普通话、粤语、英语、日语、韩语、德语、法语等多语种生成。

3、人像演绎生成:专注人物为中心的生成场景,表情自然、动作生动、情感表达细腻。

4、极速推理生成:单H100仅需2秒生成5秒256p视频,可满足实时交互场景。

5、高清分辨率扩展:基于隐空间超分,可从基础分辨率升级至540p/1080p高清视频。

daVinci-MagiHuman核心优势:

1、架构简洁高效:单流统一建模,无复杂跨注意力与模态分支,系统复杂度低,训练与推理更易优化。

2、音画高度同步:原生多模态联合建模,语音、口型、表情、动作语义一致,解决传统方案对齐差问题。

3、推理速度极快:2秒级出图+隐空间超分+TurboVAE+全图编译+蒸馏加速,接近实时生成体验。

4、多语言覆盖全面:支持主流语种及粤语,全球化内容生产友好。

5、人像生成质量突出:专注人物演绎,面部表情、语音情感、肢体动作自然逼真,达到可商用的演绎级效果。

daVinci-MagiHuman项目地址:

1、GitHub仓库:https://github.com/GAIR-NLP/daVinci-MagiHuman

2、HuggingFace模型库:https://huggingface.co/GAIR/daVinci-MagiHuman

3、arXiv技术论文:https://arxiv.org/pdf/2603.21986

4、在线体验Demo:https://huggingface.co/spaces/SII-GAIR/daVinci-MagiHuman

DataChef模型 - 上海AI Lab联合复旦大学开源的AI数据配方生成模型

Nemotron-Cascade 2模型官网 - 英伟达正式开源的MoE混合专家模型,总参数量达30B

Hugging Face模型库官网入口,AI模型的GitHub

Hypernova-60B-2602模型,Multiverse发布的免费开源压缩大模型

Steerling-8B模型使用入口,80亿参数规模,在1.35万亿Token语料上训练完成

标签: arXiv技术论文, GAIR实验室, GitHub仓库, HuggingFace模型库, 音视频大模型

上面是“daVinci-MagiHuman音视频生成模型 - 模型采用150亿参数的单流Transformer架构”的全面内容,想了解更多关于 AI项目和框架 内容,请继续关注web建站教程。

当前网址:https://m.ipkd.cn/webs_32035.html

声明:本站提供的所有资源部分来自互联网,如果有侵犯您的版权或其他权益,请发送到邮箱:admin@ipkd.cn,我们会在看到邮件的第一时间内为您处理!

mysql的10061错误是什么意思(附解决方法)

mysql的10061错误是什么意思(附解决方法) 堆友相机:创建属于自己的数字人分身,打造个性化AI相机

堆友相机:创建属于自己的数字人分身,打造个性化AI相机 疯狂翻译师官网:一款智能翻译软件,支持200+种语言的即时互译

疯狂翻译师官网:一款智能翻译软件,支持200+种语言的即时互译