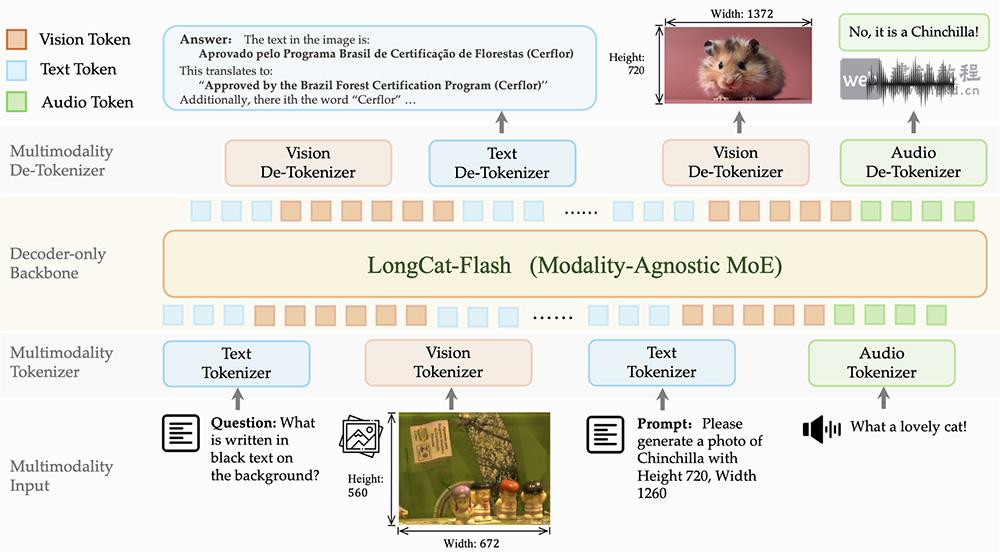

LongCat-Next是美团龙猫团队(Meituan LongCat)推出的新一代多模态模型,核心创新为LoZA稀疏注意力机制。模型通过智能评估模块重要性,将50%低重要模块替换为流式稀疏注意力,构建全局与局部交错的ZigZag结构,实现1M超长上下文、解码速度提升10倍、算力节省30%、硬件利用率翻倍,并提供Flash-Exp与Flash-Lite双版本,长文本任务表现超越Qwen-3。

LongCat-Next核心功能:

1、超长上下文理解:支持100万Token超长文本处理,同等硬件可处理两倍长度文档。

2、LoZA稀疏注意力:智能筛选模块重要性,以ZigZag交错结构实现全局与局部注意力高效协同。

3、推理全流程加速:128K上下文解码速度提升10倍,256K预加载提速50%,显著降低长文本耗时。

4、算力成本优化:256K解码阶段算力消耗降低30%,支持企业低成本部署长文本服务。

5、双版本灵活适配:Flash-Exp:1M上下文实验版;Flash-Lite:68.5B MoE架构轻量版。

6、长文本性能领先:在MRCR长文本基准测试超越Qwen-3,复杂文档问答、代码生成更稳定可靠。

LongCat-Next核心优势:

1、1M超长上下文:突破长文本瓶颈,同等硬件实现2倍长度文档处理能力。

2、LoZA高效稀疏架构:自动识别模块重要性,50%低重要模块采用流式稀疏注意力,全局与局部信息协同更精准。

3、极致推理加速:128K解码提速10倍、256K预加载提速50%,长文本响应大幅缩短。

4、部署成本更低:解码阶段算力节省30%,企业无需升级硬件即可部署高性能长文本服务。

5、性能领先且稳定:MRCR测试超越Qwen-3,通用场景效果持平,复杂文档与代码任务更可靠。

LongCat-Next使用方式:

1、开源部署:前往GitHub仓库下载模型权重与推理代码,完成本地部署。

2、硬件适配:依托LoZA稀疏注意力机制,现有硬件即可实现2倍长文本处理能力,无需额外升级高端设备。

Ming-omni-tts音频生成模型官网使用入口,优于SeedTTS、GLM-TTS

LongCat-Flash-Thinking-2601:美团LongCat团队推出高效混合专家大模型

LongCat-Flash-Lite官网:美团新一代高效大语言模型

UNO-Bench:美团LongCat团队研发全模态大模型的标准化评测基准

Ming-UniAudio:蚂蚁集团推出的开源音频多模态大模型

上面是“LongCat-Next多模态模型 - 美团龙猫团队推出支持100万Token超长文本处理”的全面内容,想了解更多关于 AI项目和框架 内容,请继续关注web建站教程。

当前网址:https://m.ipkd.cn/webs_32032.html

声明:本站提供的所有资源部分来自互联网,如果有侵犯您的版权或其他权益,请发送到邮箱:admin@ipkd.cn,我们会在看到邮件的第一时间内为您处理!

如何利用uni-app获取微信步数(附代码)

如何利用uni-app获取微信步数(附代码) 一款一键生成电影AI工具——LTX Studio

一款一键生成电影AI工具——LTX Studio 壹伴

壹伴 dm5漫画官网:一个拥有丰富的动漫资源库,可以下载APP

dm5漫画官网:一个拥有丰富的动漫资源库,可以下载APP